第四代英特尔至强可扩展处理器,AI能力实现多至十倍提升

英特尔在自己最擅长的 CPU 上完成了一次 AI 计算的革新。

人工智能技术改变了我们的生活,而说到 AI 背后的算力,人们经常会先想到 GPU。从 2019 年英特尔为其第二代至强可扩展处理器增添了内置的深度学习加速技术后,原本定位通用计算的 CPU 芯片,也加入了为 AI 加速的行列。

今天,代号为「Sapphire Rapids」的第四代至强可扩展处理器也在中国迎来发布首秀,除了一系列微架构的革新和技术规格的升级外,新 CPU 对 AI 运算「更上层楼」的支持也格外引人关注,其背后的技术助力,也是英特尔在这代产品中增添的全新内置 AI 加速器 —— 英特尔高级矩阵扩展(AMX)技术自然也成为了焦点。

作为焦点,当然要拿出实力来证明自己的价值 —— 在发布会上,英特尔透露的第四代至强可扩展处理器的基础算力平均提升值为 53%,而在 AMX 的助推下,其在 PyTorch 上的 AI 实时推理速度,可提升至上一代产品(FP32)的 5.7-10 倍,训练性能提升最高也能提升到上一代产品的 10 倍…… 这意味着,这款新至强,把业界顶级 CPU 的性能门槛一下子提高了不少。

新一代英特尔 CPU 为 AI 任务处理找到了新方向。现在,英特尔可以通过新 CPU 和 GPU 实现对各类 AI 任务的加速。为实现这些提升,英特尔引入了一系列内置加速单元。

多种加速器加持,提升 AI 训练、推理及端到端性能

AI 的热度,从 AlphaGo 一鸣惊人后,一直就没有减退。最近一段时间,人们都在谈论 ChatGPT 等「大模型」带来的革命性体验。由预训练模型方法推动的 AI 技术正在向跨任务、跨模态的方向演进,已成为当下 AI 技术发展的重要趋势。

然而,大模型虽然带来了前所未有的 AI 能力,又对算力提出了无穷无尽的需求。芯片制造商和科技公司一直在寻找提升 AI 应用效率的方法。GPU 更多解决的,是训练效率,是探索 AI 算法边界的能力,而 CPU,似乎更适合在 AI 应用的规模化部署和实践上发挥重要作用。

自从四五年前开始在 CPU 中内置针对 AI 进行加速的专用运算单元或指令集后,英特尔就一直相信,如果想要在更为广泛的行业中真正推进 AI 应用的普及,那么就应该充分利用现阶段应用和部署最为广泛的 IT 基础设施和架构,也就是要更加充分地利用 CPU 的资源。毕竟使用 GPU 和其他专用加速器的成本以及知识和人才门槛都非常高。相比之下,CPU 内置 AI 加速能力,主攻 AI 推理加速,并搭配以更为简单易用、能够部署和优化难度的软件工具,会是一条更为行之有效的路径。

它是这么想,也是这么做的 —— 首先,从 2017 年第一代至强可扩展芯片开始,英特尔就开始利用英特尔高级矢量扩展 512 技术(AVX-512 指令集)的矢量运算能力对 AI 进行加速上的尝试,到 2018 年英特尔在第二代至强可扩展芯片导入深度学习加速(DL Boost)技术,更是让至强成为了首款集成 AI 加速有力的主流数据中心级 CPU,或者说:CPU 加速 AI 的代名词。

- 2023-01-12 12:00第四代英特尔至强可扩展处理器,AI能力实现多至十倍提升

- 2023-01-12 10:53探索技术背后的故事:云边协同让VR彻底融入智慧医疗

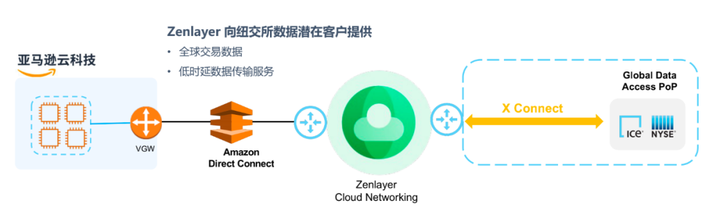

- 2022-12-08 17:29Zenlayer 携手亚马逊云科技助力全球大型交易所 ICE 向全球用户提供低延迟的市场数据服务

- 2022-12-08 15:46你们要的AMD来了,云服务器BCC发布5款Milan架构新实例

- 2022-12-02 12:4310GW!旭合科技N型电池组件项目落户滁州建设